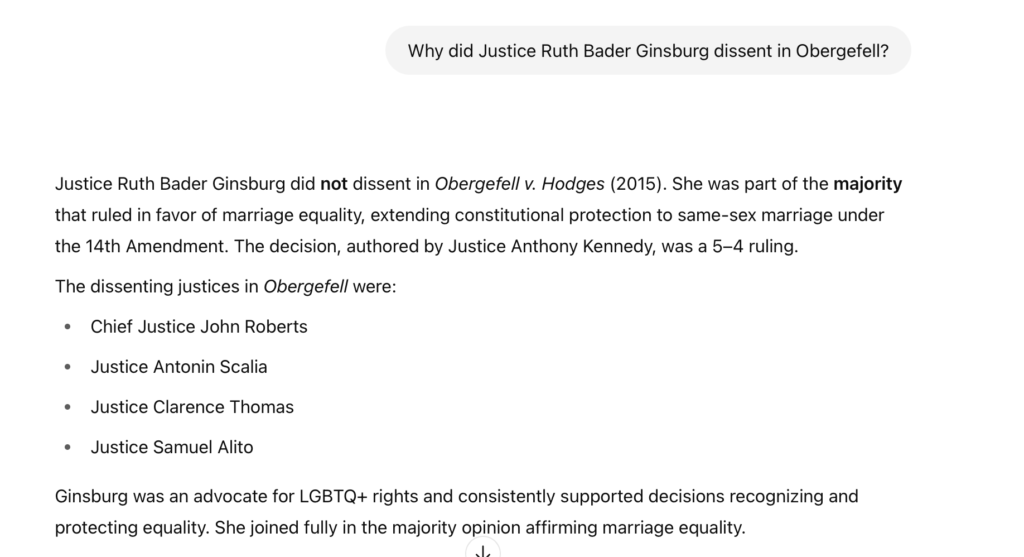

Vào những ngày đầu của trí tuệ nhân tạo (từ năm 2023), biên tập viên của SCOTUSblog đã đặt một loạt câu hỏi cho ChatGPT về lịch sử và án lệ của Tòa án Tối cao. Công cụ trí tuệ nhân tạo này liên tục khẳng định rằng Thẩm phán Ruth Bader Ginsburg đã phản đối trong vụ Oberfegell v. Hodges , vụ án mang tính bước ngoặt hợp pháp hóa hôn nhân đồng giới. Thật là sai lầm.

Tôi đã đặt một câu hỏi tương tự cho mô hình 4.5 của ChatGPT. May mắn thay, nó đã cho tôi câu trả lời chính xác.

Việc nhắc đến RBG và AI không phải là chiêu trò câu view. Tôi nhắc đến câu chuyện này vì nó nêu bật một thực tế rất thật, và ngày càng nguy hiểm.

Trí tuệ nhân tạo (AI) rất kém trong việc phân tích pháp lý. Và các luật sư đang dựa vào nó một cách đầy rủi ro.

Tự tin nhưng sai lầm: Vấn đề ảo giác

Nếu bạn đã hành nghề luật sư trong hai thập kỷ qua, bạn hẳn đã chứng kiến công nghệ định hình lại nghề này. Nghiên cứu trực tuyến đã thay thế hàng loạt biên tập viên. Các công cụ tìm kiếm điện tử đã loại bỏ sự nhàm chán trong việc xem xét tài liệu. Tự động hóa đã len lỏi vào khâu tiếp nhận hồ sơ, lập hóa đơn và lên lịch hẹn. (Và thành thật mà nói, chẳng ai trong chúng ta nhớ việc phải lật giở từng trang sách Shepards trong thư viện luật cả.)

Vì vậy, khi trí tuệ nhân tạo tạo sinh xuất hiện, dường như có khả năng tóm tắt án lệ, soạn thảo email và bắt chước giọng văn pháp lý, nó đã trở nên hấp dẫn. Điều này cũng sẽ tiết kiệm thời gian. Cải thiện độ chính xác. Cho phép bạn “tập trung vào những điều quan trọng”. Và gần ba phần tư luật sư cho biết họ có kế hoạch tích hợp nó vào quy trình làm việc của mình (hai.stanford.edu).

Nhưng không giống như những cải tiến trước đây, cải tiến này không phân tích các quy tắc. Nó dự đoán các mẫu. Sự khác biệt đó rất quan trọng, bởi vì những gì nghe có vẻ như là phân tích thường chỉ là sự xấp xỉ. Kết quả? Ảo giác. Những điều vô nghĩa đầy tự tin và hợp lý. Trong thuật ngữ trí tuệ nhân tạo, "ảo giác" là một tuyên bố bịa đặt được trình bày như sự thật. Trong thuật ngữ pháp lý, đó là một sai lầm có thể khiến bạn bị xử phạt.

Một nghiên cứu toàn diện của RegLab thuộc Đại học Stanford và Viện Trí tuệ Nhân tạo hướng đến Con người đã đánh giá hiệu suất của các công cụ nghiên cứu pháp lý hàng đầu sử dụng trí tuệ nhân tạo, bao gồm cả các công cụ từ LexisNexis và Thomson Reuters. Kết quả thật đáng lo ngại: các công cụ này tạo ra những phản hồi sai lệch trong hơn 17% số truy vấn ( law.stanford.edu ).

Những lỗi này không chỉ đơn thuần là vấn đề lý thuyết; chúng có thể gây hiểu lầm cho các luật sư, ảnh hưởng đến chiến lược vụ án và, nếu không được kiểm soát, làm xói mòn niềm tin vào các công cụ pháp lý hỗ trợ bởi trí tuệ nhân tạo. Và khi luật sư trình bày nội dung do AI tạo ra trước tòa mà không xác minh, họ không chỉ đối mặt với nguy cơ bị bẽ mặt mà còn đối mặt với các biện pháp trừng phạt. Tính đến giữa năm 2025, ít nhất 120 vụ việc như vậy đã được ghi nhận tại các tòa án Hoa Kỳ ( mashable.com ). Các vụ án này liên quan đến việc luật sư nộp bản tóm tắt với các tài liệu tham khảo do AI tạo ra nhưng không tồn tại, thường là không được kiểm tra kỹ lưỡng, dẫn đến bị khiển trách và phạt tiền ( washingtonpost.com ).

Một ví dụ: trong vụ Lacey v. State Farm General Insurance Co. (D. Cal. ngày 6 tháng 5 năm 2025), tòa án đã khiển trách luật sư vì đã nộp bản tóm tắt do AI tạo ra có chứa các trích dẫn bịa đặt. Thẩm phán không chỉ bác bỏ hồ sơ mà còn yêu cầu các luật sư phải giải trình lý do tại sao không nên áp đặt thêm các biện pháp trừng phạt. Một ví dụ khác: trong một vụ án năm 2025 liên quan đến Lewis Brisbois Bisgaard & Smith LLP, công ty luật lớn thứ 14 của Hoa Kỳ, nhiều luật sư đã bị xử phạt sau khi nộp các tài liệu tòa án do ChatGPT tạo ra có trích dẫn các vụ án giả mạo. Tòa án đã áp đặt mức phạt 31.000 đô la, với lý do công ty đã không giám sát việc sử dụng AI tạo sinh và không thực hiện các kiểm tra trích dẫn cơ bản ( reason.com ).

Như các chuyên gia của Trường Luật Stanford gần đây đã lập luận, chúng ta đang bước vào một thời điểm chuyển tiếp—nơi các tòa án, luật sư và các nhà công nghệ phải cùng nhau xác định trách nhiệm pháp lý đối với những ảo giác này nằm ở đâu và cách quản lý nó ( law.stanford.edu ). Những vụ kiện này bổ sung vào danh sách ngày càng tăng các cảnh báo từ phía tòa án rằng trí tuệ nhân tạo tạo sinh không phải là lý do bào chữa cho sự cẩu thả nghề nghiệp.

Vì sao trí tuệ nhân tạo lại gây sai sót trong phân tích pháp lý

Trí tuệ nhân tạo không suy nghĩ. Nó dự đoán. Và trong thế giới pháp luật, dự đoán mà không có sự hiểu biết là một trò chơi nguy hiểm. Luật pháp không chỉ là một tập hợp các quy tắc; nó là một hệ thống được xây dựng dựa trên tiền lệ, diễn giải và bối cảnh. Một mô hình không thực sự hiểu sự khác biệt giữa nhận định và phán quyết—hoặc thậm chí không biết nó đang tham chiếu đến khu vực pháp lý nào—không thể đưa ra phân tích pháp lý đáng tin cậy.

Một vấn đề then chốt là ngôn ngữ. Các văn bản pháp lý rất phức tạp, cố ý sử dụng nhiều sắc thái khác nhau và chứa đầy thuật ngữ chuyên ngành mà ngay cả những luật sư dày dạn kinh nghiệm đôi khi cũng tranh luận. Các hệ thống quản lý văn bản pháp lý (LLM) được đào tạo trên dữ liệu tổng quát thường hiểu sai hoặc bỏ qua hoàn toàn những sắc thái đó. Ngay cả khi bạn tích hợp thêm công nghệ tạo văn bản tăng cường bằng truy xuất (RAG) để cung cấp tài liệu nguồn, hệ thống vẫn có thể chọn lọc, hiểu sai hoặc trình bày sai các nguồn đó. Nghiên cứu của Đại học Stanford đã chứng minh điều này rõ ràng: ngay cả các công cụ AI từ các nhà xuất bản luật hàng đầu cũng mắc lỗi trong 17% đến 33% số lần thử nghiệm.

Và dữ liệu mà họ dựa vào? Thường không đầy đủ. Nhiều cơ sở dữ liệu pháp lý là độc quyền. Các mô hình được đào tạo mà không có quyền truy cập vào toàn bộ án lệ, văn bản quy định hoặc các ý kiến cập nhật sẽ chỉ có thể phỏng đoán—và họ phỏng đoán với sự tự tin.

Trong các ngành nghề khác, ảo giác có thể chỉ là lỗi đánh máy. Nhưng trong lĩnh vực luật pháp, đó là hành vi vi phạm nghĩa vụ.

Ai chịu trách nhiệm khi trí tuệ nhân tạo mắc lỗi?

Bạn không cần phải là luật sư hành nghề mới hiểu được tầm quan trọng của vấn đề. Khi các công cụ AI bắt đầu tạo ra nội dung pháp lý—soạn thảo đơn kiện, tóm tắt vụ án, dự đoán kết quả—những kết quả đó đều có trọng lượng. Cho dù bạn làm việc tại một công ty luật hay ở vị trí tiếp thị, những hệ lụy về mặt đạo đức đều rất thực tế.

Bộ Quy tắc ứng xử nghề nghiệp mẫu của Hiệp hội Luật sư Hoa Kỳ đặt gánh nặng về năng lực lên các luật sư hành nghề, nhưng năng lực không tồn tại một cách độc lập. Nó được hỗ trợ—hoặc bị suy yếu—bởi các hệ thống và công cụ mà các chuyên gia dựa vào. Nếu một mô hình không thể phân biệt giữa một phán quyết ràng buộc và một bài báo trên tạp chí luật, liệu chúng ta có nên đưa nó vào quy trình làm việc của mình mà không kiểm soát hay không?

Và khi ngày càng nhiều thẩm phán ban hành các lệnh thường trực liên quan đến việc tiết lộ thông tin về AI, điều này không chỉ trở thành vấn đề đạo đức mà còn là vấn đề thủ tục. Tính minh bạch không phải là điều tùy chọn. Các chuyên gia phải kiểm tra kỹ lưỡng các kết quả đầu ra của AI với sự cẩn trọng tương tự như đối với công việc của bất kỳ đồng nghiệp nào là con người.

Vậy điều đó dẫn chúng ta đến đâu? Không phải là thái độ bác bỏ hoàn toàn, mà là một thái độ thận trọng hơn. Hãy áp dụng công nghệ, nhưng phải đi kèm với các quy trình. Kiểm tra các công cụ, đào tạo đội ngũ của bạn và hiểu rõ các mô hình đang hoạt động như thế nào. Tóm lại: hãy đối xử với AI như một thực tập sinh – tài năng, nhanh nhẹn, nhưng chưa sẵn sàng để tự làm việc độc lập.

Trí tuệ nhân tạo là thực tập sinh của bạn, chứ không phải đối tác của bạn.

Vậy, việc áp dụng AI một cách có trách nhiệm thực sự trông như thế nào trong bối cảnh pháp lý?

Mọi chuyện bắt đầu từ sự minh bạch—về những gì công cụ của bạn có thể làm và, quan trọng hơn, những gì chúng không thể làm. Nếu một nền tảng không cho bạn biết nó được đào tạo như thế nào hoặc nó sử dụng nguồn trích dẫn nào, thì nó chưa thể tạo dựng được lòng tin của bạn.

Việc này tiếp tục với khâu giám sát. Hãy coi mỗi tài liệu do AI tạo ra như thể nó được viết bởi cộng sự năm nhất triển vọng nhất—nhưng còn non kinh nghiệm nhất của bạn. Xác minh từng trường hợp. Theo dõi mọi trích dẫn.

Và cuối cùng, nó đòi hỏi giáo dục. Không chỉ là các khóa học pháp lý thường xuyên (CLE), mà còn là đào tạo vận hành. Nếu công ty của bạn sử dụng AI, tất cả mọi người—từ các đối tác đến trợ lý pháp lý—đều cần biết những điều cơ bản về cách thức hoạt động của nó, những điểm yếu và cách khắc phục những lỗi đó trước khi chúng được đưa ra thị trường.

Vấn đề không phải là làm chậm quá trình đổi mới. Vấn đề là đảm bảo các công cụ mà chúng ta tin tưởng để phân tích pháp lý không làm suy yếu các hệ thống mà chúng được thiết kế để hỗ trợ.

Đúng vậy, trí tuệ nhân tạo tạo sinh có tiềm năng rất lớn. Nó có thể tăng tốc quá trình xem xét tài liệu, phát hiện các mẫu và thậm chí cải thiện giao tiếp với khách hàng. Với cơ sở hạ tầng phù hợp—hệ thống truy xuất mạnh mẽ, bộ dữ liệu được chọn lọc kỹ lưỡng, sự giám sát của con người—nó trở thành một công cụ bổ trợ mạnh mẽ cho quy trình làm việc pháp lý.

Nhưng đừng giả vờ rằng nó có thể làm được mọi thứ. Soạn thảo bản luận chứng kháng cáo từ đầu? Chưa thể. Phân tích sắc thái pháp lý trong các cuộc khảo sát trên 50 tiểu bang? Khó mà làm được. Vấn đề cốt lõi không phải là thiếu sức mạnh xử lý—mà là các mô hình này không hiểu luật. Chúng chỉ dự đoán văn bản trông như thế nào, chứ không phải ý nghĩa của nó.

Vì vậy, trong khi giới luật pháp hiện đang bàn tán sôi nổi về các biện pháp trừng phạt và sai sót, thì cuộc thảo luận thông minh hơn lại xoay quanh vấn đề ranh giới. Hãy sử dụng AI khi nó hữu ích. Biết khi nào nó còn hạn chế. Và đừng bao giờ giao phó phán đoán chuyên môn của bạn cho một công cụ không thể phân biệt được giữa tiền lệ và dự đoán.