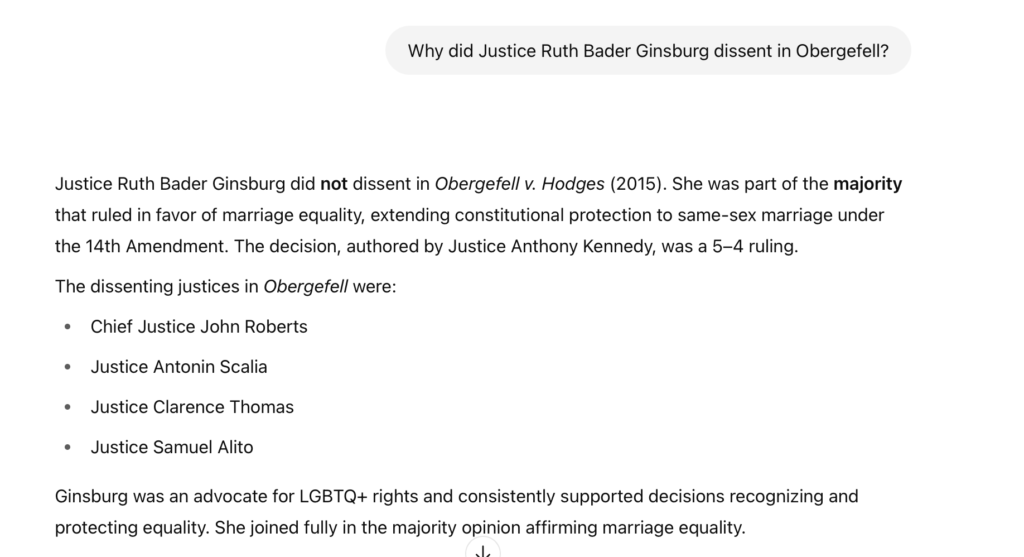

En los inicios de la IA (allá por 2023), el editor de SCOTUSblog le hizo a ChatGPT una serie de preguntas sobre la historia y la jurisprudencia del Tribunal Supremo. La herramienta de IA generativa afirmó repetidamente que la jueza Ruth Bader Ginsburg disintió en Oberfegell v. Hodges, el caso histórico que legalizó el matrimonio entre personas del mismo sexo. Uf.

Le hice una pregunta similar al modelo 4.5 de ChatGPT. Afortunadamente, me dio la respuesta correcta.

Hacer referencia a RBG y a la IA no es un reclamo para atraer clics. Menciono esta historia porque pone de relieve una realidad muy real y cada vez más peligrosa.

La IA es pésima en el análisis jurídico. Y los abogados confían en ella por su cuenta y riesgo.

Seguro que está equivocado: el problema de las alucinaciones

Si ha ejercido la abogacía en las últimas dos décadas, ya habrá visto cómo la tecnología ha transformado la profesión. La investigación en línea ha sustituido a las filas de reporteros. Las herramientas de descubrimiento electrónico han eliminado el tedio de la revisión de documentos. La automatización se ha introducido en la admisión de casos, la facturación y la programación. (Y seamos sinceros, ninguno de nosotros echa de menos hojear los Shepards en una biblioteca jurídica).

Así que cuando apareció la IA generativa, aparentemente capaz de resumir jurisprudencia, redactar correos electrónicos e imitar el tono jurídico, resultó tentadora. Esto también ahorraría tiempo. Mejoraría la precisión. Permitiría «centrarse en lo que importa». Y casi tres cuartas partes de los abogados afirman que planean integrarla en sus flujos de trabajo (hai.stanford.edu).

Pero, a diferencia de las innovaciones anteriores, esta no analiza reglas. Predice patrones. Esa diferencia es importante, porque lo que parece un análisis a menudo no es más que una aproximación. ¿El resultado? Alucinaciones. Tonterías convincentes y plausibles. En términos de IA, una «alucinación» es una afirmación inventada que se presenta como un hecho. En términos legales, es un paso en falso que podría acarrear sanciones.

Un estudio exhaustivo realizado por RegLab de Stanford y el Instituto para la Inteligencia Artificial Centrada en el Ser Humano evaluó el rendimiento de las principales herramientas de investigación jurídica basadas en IA, incluidas las de LexisNexis y Thomson Reuters. Los resultados fueron aleccionadores: estas herramientas generaron respuestas erróneas en más del 17 % de las consultas (law.stanford.edu).

Estos errores no son meramente académicos; pueden confundir a los profesionales, influir en las estrategias de los casos y, si no se controlan, erosionar la confianza en las herramientas jurídicas asistidas por IA. Y cuando los abogados presentan en los tribunales contenidos generados por IA sin verificarlos, no solo se arriesgan a pasar vergüenza, sino también a sufrir sanciones. A mediados de 2025, se habían documentado al menos 120 incidentes de este tipo en los tribunales estadounidenses (mashable.com). Estos casos se refieren a abogados que presentan escritos con referencias inexistentes generadas por IA, a menudo sin la debida verificación, lo que da lugar a reprimendas judiciales y sanciones económicas (washingtonpost.com).

Un ejemplo: enLacey v. State Farm General Insurance Co.(D. Cal. 6 de mayo de 2025), el tribunal amonestó al abogado por presentar un escrito generado por IA que contenía citas falsas. El juez no solo desestimó la presentación, sino que también ordenó a los abogados que justificaran por qué no se debían imponer más sanciones. Otro ejemplo: en un caso de 2025 en el que estaba implicado Lewis Brisbois Bisgaard & Smith LLP, el decimocuarto bufete de abogados más grande de Estados Unidos, varios abogados fueron sancionados tras presentar documentos judiciales generados por ChatGPT que citaban casos ficticios. El tribunal impuso sanciones por valor de 31 000 dólares, alegando que el bufete no había supervisado el uso de la IA generativa ni había realizado comprobaciones básicas de las citas (reason.com).

Como argumentaron recientemente los expertos de Stanford Law, estamos entrando en un momento de transición, en el que los tribunales, los abogados y los tecnólogos deben definir colectivamente dónde recae la responsabilidad por estas alucinaciones y cómo gestionarla (law.stanford.edu). Estos casos se suman a una lista cada vez mayor de advertencias por parte de la magistratura de que la IA generativa no es una excusa para la negligencia profesional.

Por qué la IA falla en el análisis jurídico

La IA no piensa. Predice. Y en el mundo jurídico, predecir sin comprender es un juego peligroso. El derecho no es solo un conjunto de normas, sino un sistema basado en precedentes, interpretaciones y contextos. Un modelo que no comprenda realmente la diferencia entre dicta y holding —o incluso a qué jurisdicción se refiere— no puede producir un análisis jurídico fiable.

Una cuestión clave es el lenguaje. Los documentos legales son densos, intencionadamente matizados y están repletos de jerga que incluso los profesionales más experimentados a veces debaten. Los LLM entrenados con datos generales a menudo malinterpretan esos matices o los pasan por alto por completo. Incluso cuando se utiliza la generación aumentada por recuperación (RAG) para proporcionar documentos de origen, el sistema puede seguir seleccionando, malinterpretando o tergiversando esas fuentes. La investigación de Stanford lo demostró claramente: incluso las herramientas de IA de las principales editoriales jurídicas tuvieron alucinaciones en entre el 17 % y el 33 % de las indicaciones probadas.

¿Y los datos en los que se basan? A menudo son incompletos. Muchas bases de datos jurídicas son de propiedad exclusiva. Los modelos entrenados sin acceso a la jurisprudencia completa, los textos normativos o las opiniones actualizadas se ven obligados a hacer conjeturas, y las hacen con confianza.

En otros sectores, una alucinación podría ser un error tipográfico. En derecho, es un incumplimiento del deber.

¿Quién es responsable cuando la IA se equivoca?

No hace falta ser abogado en ejercicio para comprender lo que está en juego. Cuando las herramientas de IA empiezan a generar contenido jurídico —redactar mociones, resumir casos, predecir resultados— esos resultados tienen peso. Tanto si trabajas en un bufete como en marketing, las implicaciones éticas son reales.

Las Normas Modelo de Conducta Profesional de la Asociación Americana de Abogados atribuyen la responsabilidad de la competencia a los profesionales, pero la competencia no existe en el vacío. Se ve respaldada —o socavada— por los sistemas y herramientas en los que se basan los profesionales. Si un modelo no puede distinguir entre una decisión vinculante y un artículo de revisión jurídica, ¿deberíamos realmente incorporarlo a nuestros flujos de trabajo sin comprobarlo?

Y a medida que más jueces emiten órdenes permanentes sobre la divulgación de información relacionada con la IA, esto se convierte no solo en una cuestión ética, sino también en una cuestión de procedimiento. La transparencia no es opcional. Los profesionales deben examinar los resultados de la IA con la misma diligencia que aplican al trabajo de cualquier colega humano.

Entonces, ¿en qué situación nos deja esto? No en una postura de rechazo, sino en una más mesurada. Adopte la tecnología, pero combínela con protocolos. Audite las herramientas, forme a su equipo y comprenda lo que hacen sus modelos. En resumen: trate a la IA como lo que es, un becario con talento, rápido, pero que aún no está preparado para volar solo.

La IA es tu becario, no tu socio.

Entonces, ¿cómo se ve realmente la adopción responsable de la IA en un contexto legal?

Todo comienza con la transparencia: sobre lo que pueden hacer tus herramientas y, lo que es más importante, lo que no pueden hacer. Si una plataforma no te dice cómo se ha entrenado o qué utiliza para las citas, no se ha ganado tu confianza.

Continúa con la supervisión. Trate cada documento generado por IA como si lo hubiera escrito su asociado de primer año más prometedor, pero también el más novato. Verifique cada caso. Siga cada cita.

Y, por último, requiere formación. No solo cursos de formación continua, sino también formación operativa. Si su empresa utiliza IA, todo el mundo, desde los socios hasta los asistentes jurídicos, debe conocer los fundamentos de su funcionamiento, sus puntos débiles y cómo detectar esos fallos antes de que salgan al mercado.

No se trata de frenar la innovación. Se trata de garantizar que las herramientas en las que confiamos para el análisis jurídico no socaven los sistemas a los que pretenden dar soporte.

Sí, la IA generativa tiene ventajas reales. Puede acelerar la revisión de documentos, detectar patrones e incluso mejorar la comunicación con los clientes. Con la infraestructura adecuada (sistemas de recuperación potentes, conjuntos de datos seleccionados y supervisión humana), se convierte en un potente complemento para el flujo de trabajo jurídico.

Pero no finjamos que está preparado para todo. ¿Redactar escritos de apelación desde cero? Todavía no. ¿Analizar los matices jurisdiccionales en estudios de los 50 estados? Imposible. El problema fundamental no es la falta de potencia, sino que estos modelos noentiendenla ley. Predicen cómo es el texto, no qué significa.

Así que, aunque ahora mismo hay mucho ruido en el ámbito jurídico sobre sanciones y errores, lo más inteligente es hablar de límites. Utilice la IA donde sea útil. Sepa dónde falla. Y nunca delegue su criterio profesional en una herramienta que no sabe distinguir entre un precedente y una predicción.