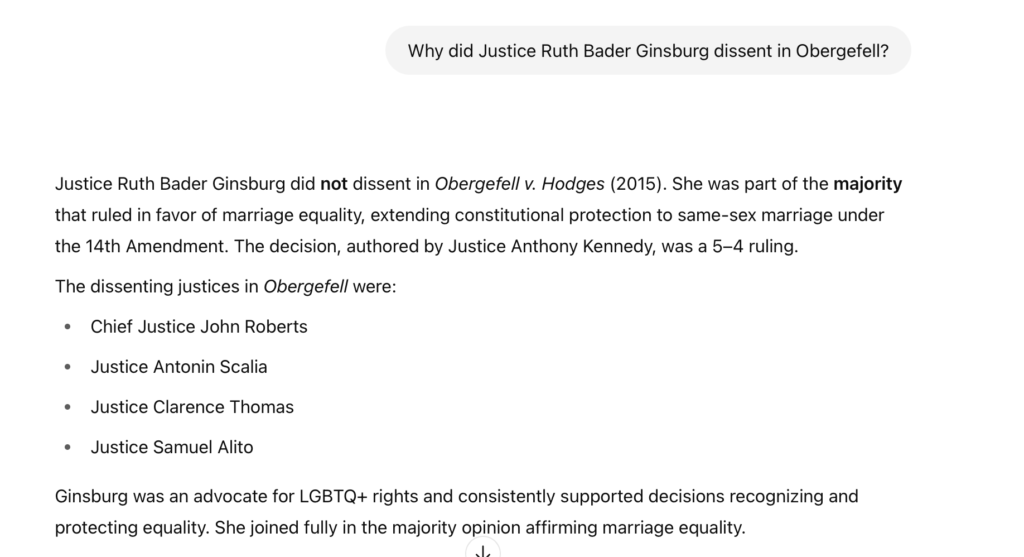

Katika siku za mwanzo za AI (zamani sana mnamo 2023), mhariri wa SCOTUSblog aliuliza ChatGPT mfululizo wa maswali kuhusu historia na sheria za Mahakama Kuu. Chombo cha AI cha kuzalisha kilidai mara kwa mara kwamba Jaji Ruth Bader Ginsburg alipinga katika kesi ya Oberfegell dhidi ya Hodges , kesi muhimu iliyohalalisha ndoa ya jinsia moja. Oof.

Niliuliza swali linalofanana na modeli ya ChatGPT ya 4.5. Kwa bahati nzuri, ilinipa jibu sahihi.

Kurejelea RBG na AI si chambo cha kubofya. Ninarejelea hadithi hii kwa sababu inaangazia ukweli halisi, na unaozidi kuwa hatari.

AI ni mbaya katika uchambuzi wa kisheria. Na wanasheria wanaitegemea kwa hatari yao.

Kwa uhakika ni makosa: Tatizo la ndoto

Kama umefanya kazi ya sheria katika miongo miwili iliyopita, tayari umeona teknolojia ikibadilisha taaluma. Utafiti wa mtandaoni ulichukua nafasi ya safu za waandishi wa habari. Vifaa vya ugunduzi wa kielektroniki viliondoa uchovu katika ukaguzi wa hati. Otomatiki iliingilia ulaji, bili, na ratiba. (Na tuwe waaminifu, hakuna hata mmoja wetu anayekosa kupitia Shepards katika maktaba ya sheria.)

Kwa hivyo wakati AI ya uzalishaji ilipojitokeza, ikionekana kuwa na uwezo wa kufupisha kesi za kisheria, kuandika barua pepe, na kuiga sauti ya kisheria, ilikuwa ya kuvutia. Hii pia ingeokoa muda. Boresha usahihi. Acha "uzingatie yale muhimu." Na karibu robo tatu ya wanasheria wanasema wanapanga kuijumuisha katika kazi zao (hai.stanford.edu).

Lakini tofauti na uvumbuzi uliopita, huu hauchanganui sheria. Unatabiri mifumo. Tofauti hiyo ni muhimu, kwa sababu kinachoonekana kama uchambuzi mara nyingi ni makadirio tu. Matokeo yake ni nini? Ndoto za kuota ndoto. Upuuzi wa kujiamini na unaowezekana. Kwa maneno ya AI, "ndoto za kuota ndoto" ni dai la kubuni linalowasilishwa kama ukweli. Kwa maneno ya kisheria, ni hatua isiyo sahihi ambayo inaweza kukufanya upigwe marufuku.

Utafiti wa kina uliofanywa na RegLab ya Stanford na Taasisi ya Akili Bandia Inayozingatia Binadamu ulitathmini utendaji wa zana kuu za utafiti wa kisheria za AI, ikiwa ni pamoja na zile kutoka LexisNexis na Thomson Reuters. Matokeo yalikuwa ya kutia wasiwasi: zana hizi zilitoa majibu yasiyo na maana katika zaidi ya 17% ya maswali ( law.stanford.edu ).

Makosa haya si ya kitaaluma tu; yanaweza kuwapotosha watendaji, kushawishi mikakati ya kesi, na, yasipodhibitiwa, hupunguza uaminifu katika zana za kisheria zinazosaidiwa na AI. Na wanasheria wanapowasilisha maudhui yanayotokana na AI mahakamani bila kuyathibitisha, hawahatarishi tu aibu—wanahatarisha vikwazo. Kufikia katikati ya mwaka wa 2025, angalau matukio 120 kama hayo yameandikwa katika mahakama za Marekani ( mashable.com ). Kesi hizi zinahusisha wanasheria wanaowasilisha marejeleo yenye marejeleo yasiyotokana na AI, mara nyingi bila uhakiki sahihi, na kusababisha karipio la kimahakama na adhabu za kifedha ( washingtonpost.com ).

Mfano mmoja: katika kesi ya Lacey dhidi ya State Farm General Insurance Co. (D. Cal. Mei 6, 2025), mahakama ilimkosoa wakili kwa kuwasilisha hati iliyotengenezwa kwa AI iliyo na nukuu bandia. Jaji hakufuta tu faili hilo lakini pia aliwaamuru mawakili kuonyesha sababu kwa nini vikwazo zaidi havipaswi kutolewa. Mwingine: katika kesi ya 2025 inayomhusisha Lewis Brisbois Bisgaard & Smith LLP, kampuni ya 14 kwa ukubwa nchini Marekani, mawakili wengi waliadhibiwa baada ya kuwasilisha hati za mahakama zilizotolewa na ChatGPT zilizotaja kesi za uwongo. Mahakama iliweka vikwazo vya $31,000, ikitaja kushindwa kwa kampuni hiyo kusimamia matumizi ya AI bandia na kufanya ukaguzi wa msingi wa nukuu ( reason.com ).

Kama wataalamu wa Sheria ya Stanford walivyosema hivi majuzi, tunaingia katika wakati wa mpito—ambapo mahakama, wanasheria, na wataalamu wa teknolojia lazima wafafanue kwa pamoja mahali ambapo dhima ya ndoto hizi iko na jinsi ya kuzidhibiti ( law.stanford.edu ). Kesi hizi zinajiunga na orodha inayoongezeka ya maonyo kutoka kwa benchi kwamba AI ya uzalishaji si kisingizio cha uzembe wa kitaaluma.

Kwa nini AI inavuruga uchambuzi wa kisheria

AI haifikirii. Inatabiri. Na katika ulimwengu wa kisheria, utabiri bila ufahamu ni mchezo hatari. Sheria si seti ya sheria tu; ni mfumo uliojengwa juu ya mfano, tafsiri, na muktadha. Mfano ambao hauelewi kweli tofauti kati ya dicta na kushikilia—au hata ni mamlaka gani inarejelea—hauwezi kutoa uchambuzi wa kisheria unaoaminika.

Suala moja muhimu ni lugha. Nyaraka za kisheria ni nzito, zenye nukta za makusudi, na zimejaa lugha nyingi ambazo hata wataalamu wenye uzoefu wakati mwingine hujadili. Wataalamu wa LLM waliofunzwa kuhusu data ya jumla mara nyingi husoma vibaya nukta hiyo au kuificha kabisa. Hata unapotumia Kizazi Kilichoongezwa Upya (RAG) kutoa hati chanzo, mfumo bado unaweza kuchagua, kutoelewa, au kupotosha vyanzo hivyo. Utafiti wa Stanford ulionyesha hili wazi: hata zana za AI kutoka kwa wachapishaji wakuu wa sheria zilidanganya katika 17% hadi 33% ya vidokezo vilivyojaribiwa.

Na data wanayotegemea? Mara nyingi haijakamilika. Hifadhidata nyingi za kisheria ni za kibinafsi. Mifano iliyofunzwa bila ufikiaji wa sheria kamili ya kesi, maandishi ya udhibiti, au maoni ya kisasa huachwa wakikisia—na wanakisia kwa kujiamini.

Katika tasnia zingine, ndoto za usiku zinaweza kuwa kosa la kuandika. Kisheria, ni uvunjaji wa wajibu.

Nani anawajibika akili bandia inapokosea?

Huna haja ya kuwa wakili anayefanya kazi ili kuelewa kinachohusika. Vifaa vya AI vinapoanza kutoa maudhui ya kisheria—kuandika hoja, kufupisha kesi, kutabiri matokeo—matokeo hayo yana uzito. Iwe uko katika kampuni au kiti cha uuzaji, athari za kimaadili ni halisi.

Sheria za Mfano za Maadili ya Kitaalamu za Chama cha Wanasheria cha Marekani zinawapa mzigo wa uwezo watendaji, lakini uwezo haupo katika ombwe. Unaungwa mkono—au kudhoofishwa—na mifumo na zana ambazo wataalamu hutegemea. Ikiwa mfumo hauwezi kutofautisha kati ya uamuzi wa lazima na makala ya mapitio ya sheria, je, tunapaswa kuuingiza katika mtiririko wetu wa kazi bila kudhibitiwa?

Na kadri majaji wengi wanavyotoa amri za kudumu kuhusu ufichuzi wa AI, hili haliwi suala la kimaadili tu bali ni suala la kiutaratibu. Uwazi si jambo la hiari. Wataalamu lazima wachunguze matokeo ya AI kwa uangalifu uleule wanaoutumia kwa kazi ya mwenzao yeyote wa kibinadamu.

Kwa hivyo hilo linatuacha wapi? Sio katika msimamo wa kukataliwa, bali katika mtazamo uliopimwa zaidi. Tumia teknolojia, lakini ioanishe na itifaki. Kagua zana, fundisha timu yako, na uelewe kile ambacho wanamitindo wako wanafanya. Kwa kifupi: mtendee AI kama mwanafunzi aliyefunzwa—mwenye talanta, mwepesi, lakini hayuko tayari kuruka peke yake.

AI ni mwanafunzi wako wa ndani, si mshirika wako

Kwa hivyo, kupitishwa kwa AI kwa uwajibikaji kunaonekanaje katika muktadha wa kisheria?

Inaanza na uwazi—kuhusu kile ambacho vifaa vyako vinaweza kufanya na, muhimu zaidi, kile ambacho haviwezi kufanya. Ikiwa jukwaa halitakuambia jinsi lilivyofunzwa au kile kinachotumika kwa nukuu, halijapata uaminifu wako.

Inaendelea kwa uangalizi. Tibu kila hati iliyozalishwa na AI kama ilivyoandikwa na mshirika wako wa mwaka wa kwanza mwenye matumaini makubwa—lakini mwenye msimamo wa kijani zaidi. Thibitisha kila kesi. Fuata kila nukuu.

Na mwishowe, inahitaji elimu. Sio tu CLE, bali pia mafunzo ya uendeshaji. Ikiwa kampuni yako inatumia akili bandia (AI), kila mtu—kuanzia washirika hadi wasaidizi wa kisheria—anapaswa kujua misingi ya jinsi inavyofanya kazi, mahali inaposhindwa, na jinsi ya kubaini kushindwa huko kabla ya kutoka nje.

Hili si kuhusu kupunguza kasi ya uvumbuzi. Ni kuhusu kuhakikisha zana tunazoamini katika uchambuzi wa kisheria hazidharau mifumo ambayo imekusudiwa kuunga mkono.

Ndiyo, AI ya kuzalisha ina faida kubwa. Inaweza kuharakisha mapitio ya hati, kubainisha mifumo, na hata kuboresha mawasiliano ya mteja. Kwa miundombinu sahihi—mifumo imara ya urejeshaji data, seti za data zilizopangwa, usimamizi wa binadamu—inakuwa nyongeza yenye nguvu kwa mtiririko wa kazi wa kisheria.

Lakini tusijifanye kuwa tayari kwa kila kitu. Kuandika muhtasari wa rufaa kuanzia mwanzo? Bado. Kuchambua nuance ya mamlaka katika tafiti za majimbo 50? Kufaulu kwa ukali. Suala kuu si ukosefu wa nguvu za kiume—ni kwamba mifumo hii haielewi sheria. Wanatabiri maandishi yanavyoonekana, si maana yake.

Kwa hivyo ingawa kuna kelele nyingi katika uwanja wa kisheria hivi sasa kuhusu vikwazo na makosa, mazungumzo ya busara zaidi ni kuhusu mipaka. Tumia akili bandia inaposaidia. Jua inapokosekana. Na kamwe usitumie uamuzi wako wa kitaalamu kwa chombo ambacho hakiwezi kutofautisha kati ya mfano na utabiri.